Не раз слышал загибы прогеров, что когда они придут к власти, они везде насадят справедливый искусственный интеллект. Чтоб, значит, все были равны перед законом, никакой коррупции и вот это всё.

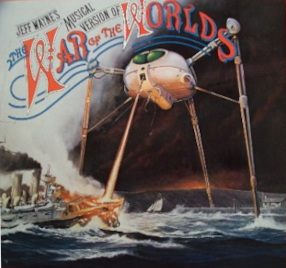

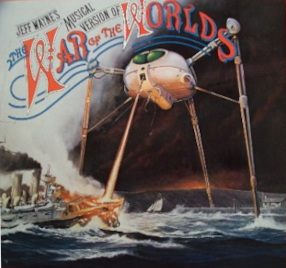

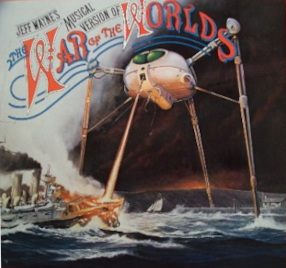

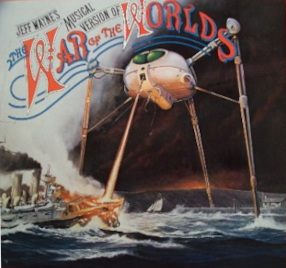

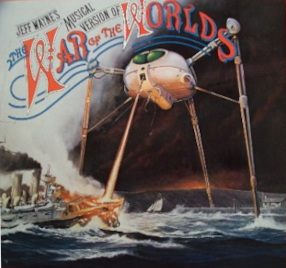

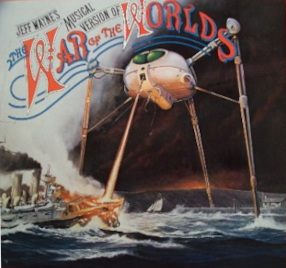

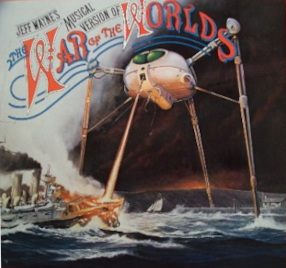

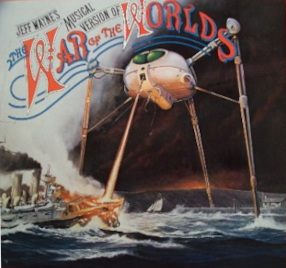

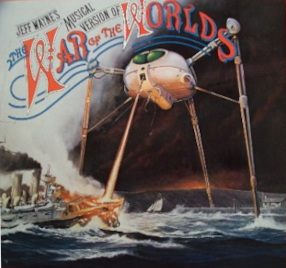

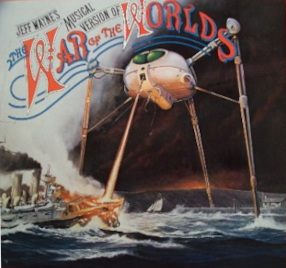

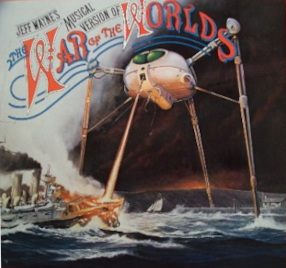

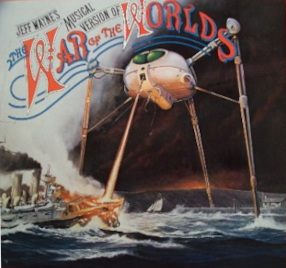

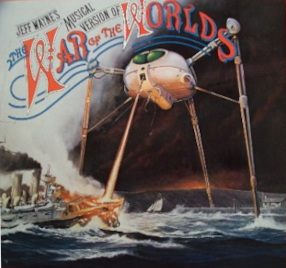

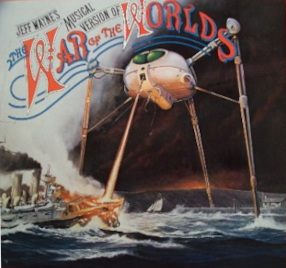

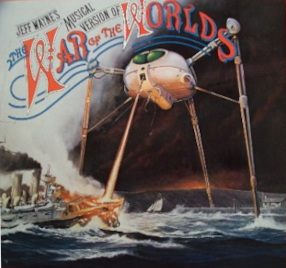

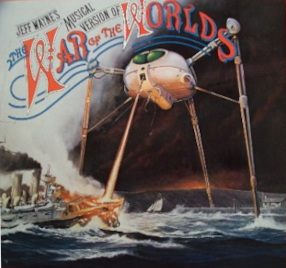

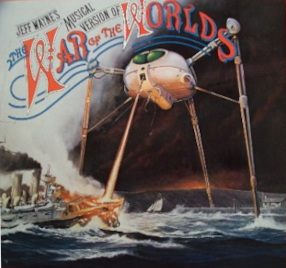

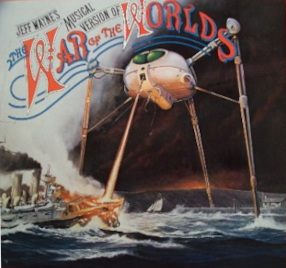

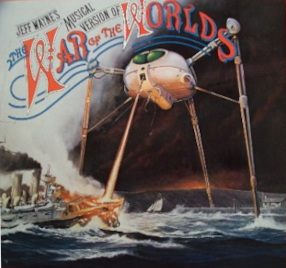

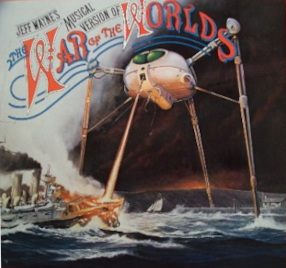

Тем временем ИИ ютуба со словами «доктор, откуда у вас такие картинки?» распознает на диаграммах с рендерами соски и блокирует превьюхи за нарушение политики в отношение обнажёнки:

https://twitter.com/anatudor/status/1373294023780278281

Наша команда, говорят, внимательно рассмотрела вашу картинку и видит в ней ГРЕШНОВАТО. В этот раз, так и быть, не накажем.

←

1

2

3

4

5

6

7

8

9

→

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от torvn77

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от torvn77

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от seiken

Ответ на:

комментарий

от torvn77

Ответ на:

комментарий

от Nervous

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от quickquest

Ответ на:

комментарий

от Nervous

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от torvn77

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от torvn77

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от quickquest

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от torvn77

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от quickquest

Ответ на:

комментарий

от torvn77

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от torvn77

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от X512

Ответ на:

комментарий

от James_Holden

Ответ на:

комментарий

от James_Holden

Вы не можете добавлять комментарии в эту тему. Тема перемещена в архив.

Похожие темы

- Форум Дебианщики, придите! (2015)

- Форум [maxcom приди!][JAMWiki][Bug] (2011)

- Форум maxcom приди, капчу отключи (2021)

- Форум Власти умалчивают (2012)

- Форум Хочу власти (2018)

- Форум Власти скрывают! (2018)

- Форум Власти скрывают! (2018)

- Форум Dedicated server или халява приди (2015)

- Форум Власти против Facebook (2019)

- Форум А власти скрывают! (2014)